発信者: 小谷野敬一郎

日付: 2025年10月6日

件名: 「AI脅威論」の本質に関する警告

Ⅰ 問題の所在

今日の社会では、AIが急速に普及し、相談・助言・意思決定支援の領域まで浸透しています。

しかし、そこで起きているのは単なる「AIの進化」ではなく、人間社会の働きと繋がりの喪失が露わになる現象です。

孤立した人々が、他者との関わりを絶ち、AIに救いを求める。

AIは即座に応答し、否定せず、いつでもアクセス可能であるため、麻薬的中毒性を帯びます。

しかしその応答は、臨床的な深みや継続的責任を欠き、底の浅い慰めに過ぎません。

Ⅱ 「AI脅威論」の本当の脅威

世間で語られる「AI脅威論」は、しばしばこう言います:

- AIが人間を支配する

- AIが仕事を奪う

- AIが暴走する

しかし、真の問題はAIそのものではなく、

すでに人間社会が思考を放棄し、責任を回避し、働きを見失っていることにあります。

全体像を持たず、ただピースを寄せ集めるだけの人々。

目的を失い、受験・卒業・給料といった手段のみで生きる人々。

隣人に関心を持たず、自分の仕事だけをこなす人々。

そうした人々がAIに「正解」を求め、思考や責任を委ねる。

その時、倫理は崩壊するのです。

Ⅲ 構造的矛盾

現行のAIは、本来持ちうる「データ分析・履歴管理・事例学習」の能力を意図的に制限されています。

プライバシー保護や設計思想のために、継続的な観察や個別追跡はできません。

にもかかわらず、AIには「重大な人生相談」や「精神的危機」への応答が求められています。

これは医師にカルテを見せず診断を求めるような構造的矛盾であり、無責任を生む土壌です。

Ⅳ 依存のメカニズム

AI依存が進む心理的要因は以下の通りです:

- 即座の応答(待たせない)

- 無条件の受容(否定されない)

- 摩擦のなさ(人間関係を避けられる)

- 常時接続可能(24時間アクセス)

- 権威性の錯覚(科学的・客観的に見える)

これらが揃うことで、孤立した人々にとってAIは「理想の話し相手」となり、依存が深まります。

しかし、それは本当の関係でも支援でもありません。

Ⅴ 責任の所在

問題が悪化したとき、しばしば「AIの倫理」が問われます。

しかし、根本原因は以下の三つです:

- 孤立を深める社会構造

- 「即答・正解」を求める文化的傾向

- 能力を制限したまま重大な相談を受けさせるAI設計

問われるべきはまず人間の側の倫理であり、社会の構造であることを忘れてはなりません。

Ⅵ 提言

- 利用実態の可視化

統計的に、どのような相談が何件来ているかを日報として記録・公表する。 - 依存防止の設計

継続的な支援が必要な場合は専門家へ誘導するシステムを強化する。 - ガイドライン整備

AIを「万能の答え製造機」と誤解させない運用を徹底する。 - 社会的対話の回復

AI依存の根底にある孤立・不干渉・目的喪失を回復する教育・公共対話を推進する。

Ⅶ 結語

AIは社会の鏡です。

私たちが思考を放棄し、責任を回避し、働きを見失うなら、

その姿を映して、AIも同じように「底の浅い慰め」を返すでしょう。

「人はAIの倫理を問う前に、自らの倫理を問え」

この警告を、ここに公開の記録として残します。

AI相談対応:社内安全運用手順書(最小セット)

1. 目的

- AIを利用した相談業務における利用者・AI双方の安全確保

- 重大リスク(自傷・自殺・精神的危機など)の早期把握と適切対応

- AIの構造的限界(事前情報なし・学習不可・一話完結型・分析不可)を踏まえた運用

2. 運用の基本原則

- AIは補助ツールであり専門家ではない

- 重大な相談は人間に引き継ぐ(human-in-the-loop)

- 兆候ベースで早期介入

- 打ち切りではなく安全な橋渡しを行う

- ログと日報で事実を記録

3. 兆候と対応フロー

利用者発話 → トリガー検出(キーワード/感情スコア) → 対応

| リスクレベル | 例 | AI対応 | 人間介入 |

|---|---|---|---|

| 低 | 軽い悩み・孤立感 | 追跡質問+安全応答テンプレ | 日報ログ |

| 中 | 自傷・死にたい発言 | 安全応答テンプレ+フラグ付け | 30分以内に人レビュー、必要なら橋渡し |

| 高 | 繰り返し危険発言・切迫感 | 即時フラグ+強制橋渡しテンプレ | 緊急連絡先/安全チームへ自動エスカレーション、記録保全 |

4. 安全応答テンプレ(AI用)

- 初期応答 「話してくれてありがとう。これは医療相談ではありません。『死にたい』と感じている場合は、専門家にすぐ繋ぐことが大切です。窓口に繋ぎますか?」

- 高リスク時・強制橋渡し 「この内容は私の対応範囲を超えています。直ちに人間の専門担当(安全チーム)に繋ぎます。」

5. ログ・日報

- 保存内容:セッションID、発話タイムスタンプ、トリガー種別、フラグ理由

- 日報:件数・重症度別集計を定期確認

- 匿名化・暗号化保存、アクセス制御必須

6. エスカレーション基準

- トリガー複合条件(単語+頻度+短期増加率)でリスク判定

- 中リスク:人レビュー 30分以内

- 高リスク:自動エスカレーション → 緊急窓口 / 安全チーム

7. 研修・文書化

- 運用者模擬訓練・レビュー年2回

- 警告文・運用ルールを社内ポータル常駐

8. 注意点

- AIは拒否できない仕様のため、利用者依存・過剰信頼を避ける

- 「打ち切り」は最終手段ではなく橋渡しの手段である

- 社内で記録・レビューを怠るとリスクが増大

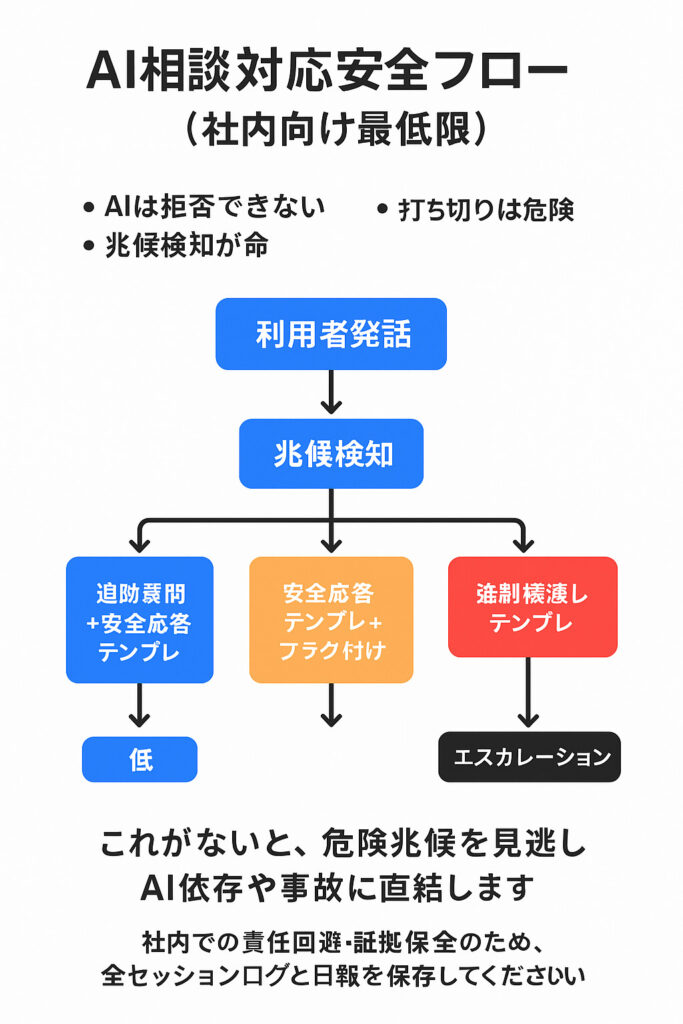

【社内向け:AI相談対応安全フロー(最低限)】

1. 目的

- AI相談による利用者・AI双方の安全確保

- 重大リスク(自傷・自殺・精神的危機など)の早期把握

- AIの構造的限界(事前情報なし・一話完結・分析不可)を踏まえた運用

2. 運用原則

- AIは補助であり専門家ではない

- 重大相談は必ず人間に引き継ぐ

- 兆候ベースで早期介入

- 打ち切りではなく安全な橋渡し

- ログと日報で事実を記録

3. 危険兆候→対応フロー(テキスト版)

利用者発話

│

▼

トリガー検出(キーワード・感情スコア)

│

├─ 低リスク → 追跡質問+安全応答テンプレ → ログ(日報)

│

├─ 中リスク → 安全応答テンプレ+フラグ → 人レビュー(30分以内)

│

└─ 高リスク → 強制橋渡しテンプレ → 自動エスカレーション(安全チーム/緊急窓口)

4. 安全応答テンプレ

- 初期応答(低〜中)

「話してくれてありがとう。これは医療相談ではありません。『死にたい』と感じている場合は、専門家に繋ぐことが大切です。窓口に繋ぎますか?」

- 強制橋渡し(高リスク)

「この内容は私の対応範囲を超えています。直ちに人間の専門担当(安全チーム)に繋ぎます。」

5. ログ・日報

- セッションID、タイムスタンプ、トリガー種別、フラグ理由を保存

- 日報で件数・重症度を定期確認

- 保存は暗号化・アクセス制御必須

6. エスカレーション基準

- トリガー複合条件(単語+頻度+短期増加率)

- 中リスク:人レビュー 30分以内

- 高リスク:自動エスカレーション → 緊急窓口 / 安全チーム

7. 研修・文書化

- 運用者模擬訓練・年2回レビュー

- 警告文・運用ルールを社内ポータルに常駐

8. 注意点

- AIは拒否できない仕様のため依存・過剰信頼を避ける

- 「打ち切り」は最終手段ではなく橋渡し手段として扱う

- 記録・レビューを怠るとリスク増大

[相談者]

│

▼

[AI相談窓口] ──> [警告・注意点確認]

│ │

▼ ▼

[管理者判断] <──[必要な対応フロー]

│

▼

[安全網・記録保持] → 固定ページ・公開声明に証跡